zkPyTorch:爲PyTorch推理注入零知識證明,打造真正可信的AI

隨着人工智能(AI)在醫療、金融、自動駕駛等關鍵領域的深入落地,保障機器學習(ML)推理過程的可靠性、透明性和安全性,正變得前所未有地重要。

然而,傳統的機器學習服務往往像「黑箱」一樣運行,用戶只能看到結果,難以驗證過程。這種不透明性讓模型服務容易暴露在風險之下:

模型被盜用、

推理結果被惡意篡改、

用戶數據面臨隱私泄露風險。

ZKML(零知識機器學習)爲這一挑戰提供了全新的密碼學解法。它依托零知識證明(ZKPs)技術,賦予機器學習模型可加密驗證的能力:證明一項計算已被正確執行,而無需透露其中的敏感信息。

換句話說,ZKPs 允許服務提供者向用戶證明:

「你所獲得的推理結果,確實是我用訓練好的模型跑出來的——但我不會泄露任何模型參數。」

這意味着,用戶可以信任推理結果的真實性,而模型的結構和參數(往往是高價值資產)則始終保持私密。

zkPyTorch:

Polyhedra Network 重磅推出 zkPyTorch——一款專爲零知識機器學習(ZKML)打造的革命性編譯器,旨在打通主流 AI 框架與 ZK 技術之間的最後一公裏。

zkPyTorch 將 PyTorch 強大的機器學習能力與前沿的零知識證明引擎深度融合,AI 開發者無需更改編程習慣,也無需學習全新的 ZK 語言,即可在熟悉的環境中,構建具備可驗證性的 AI 應用。

這款編譯器能夠自動將高層次的模型操作(如卷積、矩陣乘法、ReLU、softmax 和注意力機制)轉譯爲可被加密驗證的 ZKP 電路,並結合 Polyhedra 自研的 ZKML 優化套件,對主流推理路徑進行智能壓縮與加速,確保電路的正確性與計算效率雙重兼得。

打造可信 AI 生態的關鍵基礎設施

當今的機器學習生態系統,正面臨數據安全、計算可驗證性和模型透明度等多重挑戰。尤其在醫療、金融、自動駕駛等關鍵行業,AI 模型不僅涉及大量敏感個人信息,還承載着高價值的知識產權與核心商業機密。

零知識機器學習(ZKML)應運而生,成爲解決這一困局的重要突破。通過零知識證明(ZKP)技術,ZKML 可在不泄露模型參數或輸入數據的前提下,完成模型推理的完整性驗證——既守住隱私,又保障可信。

但現實中,ZKML 開發往往門檻極高,需要深厚的密碼學背景,遠非傳統 AI 工程師所能輕鬆駕馭。

這正是 zkPyTorch 的使命所在。它爲 PyTorch 與 ZKP 引擎之間搭起了一座橋梁,讓開發者用熟悉的代碼構建具備隱私保護與可驗證性的 AI 系統,無需重新學習復雜的密碼學語言。

通過 zkPyTorch,Polyhedra Network 正在顯著降低 ZKML 的技術壁壘,推動可擴展、可信任的 AI 應用走入主流,重構 AI 安全與隱私的新範式。

zkPyTorch 工作流程

圖 1:ZKPyTorch 的整體架構概覽

如圖 1 所示,zkPyTorch 通過精心設計的三大模塊,將標準 PyTorch 模型自動轉換爲兼容 ZKP(零知識證明)的電路。這三大模塊包括:預處理模塊、零知識友好量化模塊,以及電路優化模塊。

這一流程無需開發者掌握任何加密電路或專用語法:開發者只需使用標準 PyTorch 編寫模型,zkPyTorch 即可將其轉化爲可被如 Expander 等零知識證明引擎識別的電路,生成對應的 ZK 證明。

這種高度模塊化的設計,大幅降低了 ZKML 的開發門檻,使 AI 開發者無需切換語言或學習密碼學,也能輕鬆構建高效、安全、可驗證的機器學習應用。

塊一:模型預處理

在第一階段,zkPyTorch 會將 PyTorch 模型轉換爲結構化的計算圖,採用開放神經網路交換格式(ONNX)。ONNX 是業界廣泛採用的中間表示標準,能夠統一表示各類復雜的機器學習操作。通過這一預處理步驟,zkPyTorch 能夠理清模型結構、拆解核心計算流程,爲後續生成零知識證明電路打下堅實基礎。

模塊二:ZKP 友好量化

量化模塊是 ZKML 系統中的關鍵一環。傳統機器學習模型依賴浮點運算,而 ZKP 環境更適合有限域中的整數運算。zkPyTorch 採用專爲有限域優化的整數量化方案,將浮點計算精確映射爲整數計算,同時將不利於 ZKP 的非線性操作(如 ReLU、Softmax)轉換爲高效的查找表形式。

這一策略不僅大幅減少了電路復雜度,還在確保模型精度的前提下,提升了整個系統的可驗證性與運行效率。

模塊三:分層電路優化

zkPyTorch 在電路優化方面採用多層次策略,具體包括:

批處理優化

針對序列化計算特別設計,通過一次性處理多個推理步驟,大幅降低計算復雜度和資源消耗,尤其適用於 Transformer 等大型語言模型的驗證場景。

原語操作加速

結合快速傅裏葉變換(FFT)卷積與查找表技術,有效提升卷積、Softmax 等基礎運算的電路執行速度,從根本上增強整體計算效率。

並行電路執行

充分發揮多核 CPU 和 GPU 的算力優勢,將矩陣乘法等重負載計算拆分爲多個子任務並行執行,顯著提升零知識證明生成的速度與擴展能力。

深度技術探討

有向無環圖(DAG)

zkPyTorch 採用有向無環圖(DAG)來管理機器學習的計算流程。DAG 結構能夠系統化地捕捉復雜的模型依賴關係,如圖 2 所示,圖中每個節點代表一個具體的操作(如矩陣轉置、矩陣乘法、除法和 Softmax),而邊則精確描述了這些操作之間的數據流向。

這種清晰且結構化的表示方式,不僅極大便利了調試過程,也有助於性能的深入優化。DAG 的無環特性避免了循環依賴,確保了計算順序的高效且可控執行,這對於優化零知識證明電路的生成至關重要。

此外,DAG 使 zkPyTorch 能夠高效處理諸如 Transformer 和殘差網路(ResNet)等復雜模型架構,這些模型通常具有多路徑、非線性的復雜數據流,DAG 的設計正好契合其計算需求,保證了模型推理的準確性與高效性。

圖 2:機器學習模型以有向無環圖(DAG)形式表示的示例

高級量化技術

在 zkPyTorch 中,高級量化技術是將浮點計算轉化爲適用於零知識證明(ZKP)系統中高效有限域算術的整數運算的關鍵步驟。zkPyTorch 採用靜態整數量化方法,精心設計以兼顧計算效率與模型精度,確保在生成證明時既快速又準確。

這一量化過程包含嚴格的校準,精準確定最佳量化尺度,用以有效表示浮點數,避免溢出和精度大幅損失。針對 ZKP 特有的非線性運算挑戰(例如 Softmax 和層歸一化),zkPyTorch 創新性地將這些復雜函數轉化爲高效的查表操作。

這種策略不僅大幅提升了證明生成的效率,也確保生成的證明結果與高精度量化模型的輸出完全一致,兼顧了性能與可信度,推動了可驗證機器學習的實用化進程。

多級電路優化策略

zkPyTorch 採用了高度精密的多層次電路優化體系,從多個維度出發,確保零知識推理在效率與可擴展性上的極致表現:

批處理優化(Batch Processing Optimization)

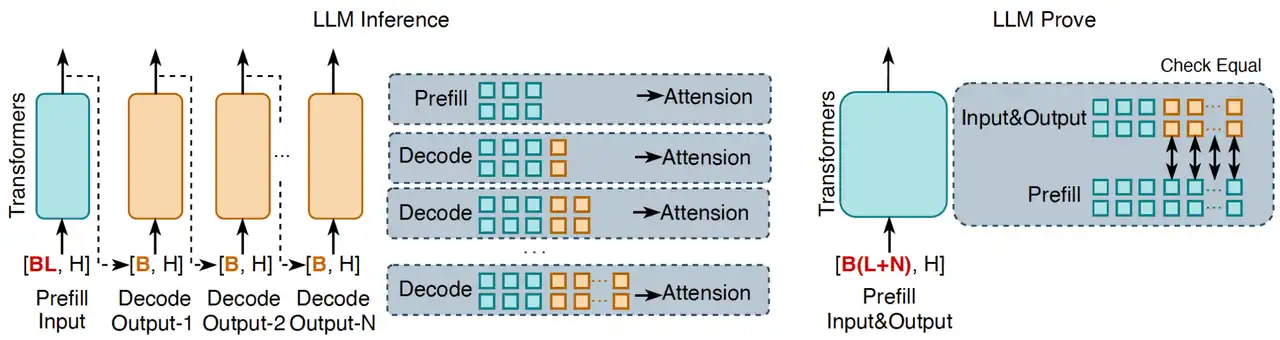

通過將多個推理任務打包爲批次處理,顯著降低整體計算復雜度,尤其適用於 Transformer 等語言模型中的序列式操作場景。如圖 3 所示,傳統的大語言模型(LLM)推理過程以逐 Token 生成方式運行,而 zkPyTorch 的創新方法則將全部輸入輸出 Token 聚合爲單一 prompt 過程進行驗證。這種處理方式能夠一次性確認 LLM 的整體推理是否正確,同時確保每個輸出 Token 與標準 LLM 推理一致。

在 LLM 推理中,KV cache(鍵值緩存)機制的正確性是保障推理輸出可信性的關鍵。如果模型的推理邏輯有誤,即便使用緩存,也無法還原出與標準解碼流程一致的結果。zkPyTorch 正是通過精確復現這一流程,確保了零知識證明中的每一個輸出都具備可驗證的確定性與完整性。

圖 3:大規模語言模型(LLMs)計算的批量驗證,其中 L 表示輸入序列長度,N 表示輸出序列長度,H 表示模型的隱藏層維度。

核心運算優化(Optimized Primitive Operations)

zkPyTorch 對底層機器學習原語進行了深度優化,極大地提升了電路效率。例如,卷積運算一向是計算密集型任務,zkPyTorch 採用基於快速傅裏葉變換(FFT)的優化手法,將原本在空間域中執行的卷積,轉換爲頻域中的乘法運算,顯著降低計算成本。同時,針對 ReLU、softmax 等非線性函數,系統採用預計算查找表(lookup table)方式,規避了 ZKP 不友好的非線性計算,極大提升了推理電路的運行效率。

並行電路執行(Parallel Circuit Execution)

zkPyTorch 將復雜的 ML 運算自動編譯爲並行電路,充分釋放多核 CPU/GPU 的硬件潛力,實現大規模並行證明生成。比如,在執行張量乘法時,zkPyTorch 會自動將計算任務拆分爲多個獨立子任務,並行分發至多個處理單元並發運行。這種並行化策略,不僅顯著提升了電路執行吞吐量,還讓大型模型的高效驗證成爲現實,爲可擴展的 ZKML 打開了新維度。

全面性能實測:性能與精度的雙重突破

zkPyTorch 通過嚴謹的基準測試,在多個主流機器學習模型中展現出卓越性能與實際可用性:

VGG-16 模型測試

在 CIFAR-10 數據集上,zkPyTorch 僅需 6.3 秒 即可完成單張圖像的 VGG-16 證明生成,且在精度上與傳統浮點計算相比幾乎無差異。這標志着 zkML 在圖像識別等經典任務中已經具備實戰能力。

Llama-3 模型測試

針對規模高達 80 億參數 的 Llama-3 大語言模型,zkPyTorch 實現了每個 token 約 150 秒 的高效證明生成。更令人矚目的是,其輸出結果與原始模型相比,保持了 99.32% 的餘弦相似度,在保證高可信度的同時,仍兼顧模型輸出的語義一致性。

表 1:各類 ZKP 方案在卷積神經網路與變換器網路中的性能表現

面向現實世界的廣泛應用場景

可驗證的機器學習即服務(Verifiable MLaaS)

隨着機器學習模型的價值不斷攀升,越來越多的 AI 開發者選擇將自研模型部署到雲端,向外提供 MLaaS(Machine-Learning-as-a-Service)服務。但在現實中,用戶往往難以驗證推理結果是否真實可信;而模型提供方也希望保護模型結構和參數等核心資產,避免被竊取或濫用。

zkPyTorch 正是爲解決這一矛盾而生:它讓雲端 AI 服務具備原生的「零知識驗證能力」,實現推理結果的加密級別可驗證。

如圖 4 所示,開發者可將如 Llama-3 等大模型直接接入 zkPyTorch,構建具備零知識證明能力的可信 MLaaS 系統。通過與底層 ZKP 引擎無縫集成,zkPyTorch 能夠在不暴露模型細節的前提下,自動生成證明,驗證每一次推理是否被正確執行,從而爲模型提供方和使用方建立真正可信的交互信任基礎。

圖 4:zkPyTorch 在可驗證機器學習即服務(Verifiable MLaaS)中的應用場景。

模型估值的安全護航

zkPyTorch 提供安全可驗證的 AI 模型評估機制,使得利益相關方在不暴露模型細節的前提下,能夠審慎評估其關鍵性能指標。這種「零泄露」的估值方式爲 AI 模型確立了新的信任標準,在提升商業交易效率的同時,保障了開發者的知識產權安全。它不僅提高了模型價值的可見性,也爲整個 AI 行業帶來了更高的透明度與公正性。

與 EXPchain 區塊鏈的深度集成

zkPyTorch 原生集成 Polyhedra Network 自主研發的 EXPchain 區塊鏈網路,共同構建可信的去中心化 AI 基礎設施。這一集成爲智能合約調用和鏈上驗證提供了高度優化的路徑,使 AI 推理結果可以在區塊鏈上獲得加密驗證並持久存證。

借助 zkPyTorch 與 EXPchain 的協同,開發者能夠構建端到端可驗證的 AI 應用,從模型部署、推理計算到鏈上驗證,真正實現透明、可信且可審計的 AI 計算流程,爲下一代區塊鏈+AI 應用提供底層支撐。

未來路線圖與持續創新

Polyhedra 將持續推進 zkPyTorch 的演進,重點聚焦以下方向:

開源與社區共建

逐步開源 zkPyTorch 核心組件,激發全球開發者參與,推動零知識機器學習領域的協同創新與生態繁榮。

拓展模型與框架兼容性

擴大對主流機器學習模型與框架的支持範圍,進一步提升 zkPyTorch 的適配能力與通用性,使其可靈活嵌入各類 AI 工作流。

開發工具與 SDK 構建

推出全面的開發工具鏈與軟件開發工具包(SDK),簡化集成流程,加速 zkPyTorch 在實際業務場景中的部署與應用落地。

結語

zkPyTorch 是通向可信 AI 未來的重要裏程碑。通過將成熟的 PyTorch 框架與前沿的零知識證明技術深度融合,zkPyTorch 不僅顯著提升了機器學習的安全性與可驗證性,更重塑了 AI 應用的部署方式與信任邊界。

Polyhedra 將持續在「安全 AI」領域深耕創新,推動機器學習在隱私保護、結果可驗證與模型合規方面邁向更高標準,助力構建透明、可信、可擴展的智能系統。

敬請關注我們不斷發布的最新進展,見證 zkPyTorch 如何重塑安全智能時代的未來。

聲明:

- 本文轉載自 [BLOCKBEATS],著作權歸屬原作者 [Jiaheng Zhang],如對轉載有異議,請聯繫 Gate Learn 團隊,團隊會根據相關流程盡速處理。

- 免責聲明:本文所表達的觀點和意見僅代表作者個人觀點,不構成任何投資建議。

- 文章其他語言版本 由Gate Learn 團隊翻譯, 在未提及 Gate 的情況下不得復制、傳播或抄襲經翻譯文章。

相關文章

Arweave:用AO電腦捕捉市場機會

即將到來的AO代幣:可能是鏈上AI代理的終極解決方案

深度分析:AI和Web3能創造什麼樣的火花?

思維網路:全面同態加密和重質押,讓AI專案安全觸手可及

關於GT-協議你需要了解的一切